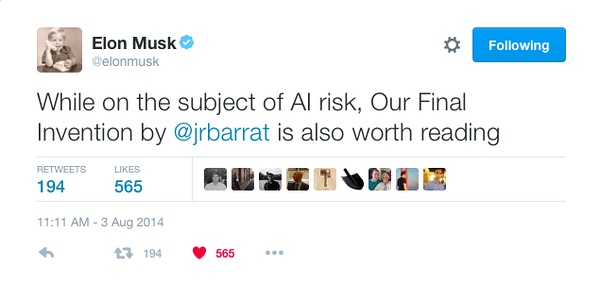

近年来,奇点主义成为人工智能领域很火的思想潮流。奇点主义代言人雷·库兹韦尔(Ray Kurzweil)推出两本畅销书:《精神机器时代:当计算机超过人类智能》和《奇点临近》。他在书中预言:未来40年的某个时候,技术发展会迅猛异常,从根本上改变人类的生存,机器和生物会变得难分彼此;虚拟世界会比现实更加生动和迷人;纳米技术将促成按需制造,终结饥饿和贫困,治愈人类的一切疾病;人们能够阻止身体老化,甚至实现逆转。除了著书立言,库兹韦尔还到处演讲,并创办了奇点大学,奇点主义之火从美国烧到了全世界。 不过“奇点”这一概念最初并不是指一个“奇异的时间点”----在这个时间点后,技术变化的步伐将不可逆转地改变人类生活:预示着人类迎来充满希望的璀璨时代----而是一个物理学上和黑洞有关的概念:“奇点”指黑洞周围轨道上的一点,一旦越过这个轨道的距离,光线就再也无法逃离黑洞。 1958年,数学家斯塔尼斯拉夫·乌拉姆(Stanislaw Ulam)和被誉为“计算机之父”、“博弈论之父”的数学家约翰·冯·伊诺曼(John von Neumann)谈论技术变化时使用了“奇点”一词。科幻作家弗诺·文奇(Vernor Vinge)则是第一个在正式场合使用“奇点”一词的人,那是1993年,他受邀在美国航空航天局(NASA)做了一场题为“即将到来的技术奇点”的演讲,向NASA描述技术的未来。自弗诺·文奇有意识的使用了这个词之后,“奇点”像雪球一样滚了起来,传到雷·库兹韦尔的手里,开启了近来的奇点运动。 反奇点主义者有话说:对于人工智能你们太过乐观! 弗诺·文奇20世纪60年代开始写科幻小说时,以科学为基础描绘四五十年后的世界。到了20世纪90年代,他感到技术的变化速度加快,时代飞速向他袭来,他预感到,很快会出现比人类智能更强的东西。那种智能(不再是人类)会确定技术进步的速度。科幻作家尝试用具体故事探讨技术能为人类做些什么,这个过程中,他们越来越觉得跟未来隔着一道不透明的墙。文奇研究这不透明的未来,并下了一个结论:奇点来势汹汹,可能导致人类灭绝!正如光线超过奇点所标的轨道便再也无法逃离黑洞,一旦我们人类开始跟比自己更聪明的实体分享地球,那便是我们全盘皆输的开始。 毫无疑问,科幻学家弗诺·文奇认为库兹韦尔领军的奇点主义者们太过乐观。有趣的是,目前最出名的两个奇点机构恰好对奇点抱着相反看法,尽管行动宗旨相异,但“南辕北辙”,实践下来,两家机构看上去好像有那么点殊途同归。库兹韦尔和同道共同创办奇点大学意在培养奇点主义者,而由同样是人工智能业内人士创办的奇点研究所却抗起了一面要赶在超级人工智能(Super AI)崛起前保护好人类生命星火的大旗。库兹韦尔们创办奇点大学的初衷是为那些准备积极契入后奇点时代的人提供基础教育,很多奇点主义者是自学成材,部分原因是目前没有任何一所大学在本科阶段能提供杂糅了计算机学、伦理学、生物工程学、神经科学、心理学、哲学等专业在内的奇点学。奇点大学不颁发学位,也没有美国教育部的认可,但创办者们承诺学生将能够“全面、跨学科地理解有关变革性技术的宏大议题和观点”。在我看来,奇点主义者有点像追求成为“上帝的选民”一样憧憬着奇点技术带来的各项利好,包括永生。 从2005年开始,奇点研究所每年都会举办在业内很有影响力的奇点峰会,在为期两天的会议上邀请重量级程序员、神经科学家、学者、企业家、伦理学家和发明家畅谈眼下这场人工智能革命的进展和挫折。奇点研究所同样位于加州,以专注宣传奇点技术的强大风险,防止因超级人工智能导致的人类灭绝为己任。奇点主义者们并非没有看到超极人工智能的风险,只是他们认为,假如人类进行智能增强(IA: Intelligence Augmentation)演化成拥有超级智能的人机共存生物,就不怕超极人工智能的威胁,可以实现某种程度的智能制衡。但是,奇点研究所核心研究员埃利泽·尤德考斯基(Eliezer Yudkowky)认为,只有将开发友好人工智能(友好AI)尽早提上日程,人类才有可能先发制人,在与不可知的超级人工智能的对抗赛中胜出。开发友好AI是一个充满探索的十分复杂的过程,尤德考斯基针对这个议题写了长篇论文,名为《创造友好AI:仁善目标结构的分析与设计》(Creating Friendly AI: The Analysis and Design of Benevolent Goal Architectures)。文中提出,除了目标满足度外,友好AI要加入价值观和偏好,但人类价值观是随时间而变化的,假设友好AI接受一项偏好是保护1700年大部分欧洲人,这一“效用函数”没有及时更新,那么到了21世纪,它或许会把欧洲人的幸福和福利跟古老的价值观,比如种族歧视、蓄奴、性别歧视等糟糕的东西联系起来,从这个角度来说,人们不应期望让友好AI锁定具体的价值观,而应期望它能跟我们一起进化,但这样一来,又会产生新的问题,即最初的目标设定是否会在友好AI的进化过程中丢失?于是尤德考斯基试图制定机器进化规范能力,让它具有一个“连贯意志”,有“连贯意志”的AI能预测我们想要什么,还知道如果我们知道更多,想得更快,更像我们以为自己是的那种人时,我们会想要什么。奇点研究所所长迈克尔·瓦瑟(Michael Vassar)瞄准精英大学和数学竞赛的外展项目,开办了一系列“理性新兵营”,希望培养出秉持理性思考态度的未来潜在 AI开发人员和技术政策制定者。等这些精英长大,他们将会把这种教育运用到工作中,避免AI酿成弥天大祸。 补充说明下,上段文字提到的AI是特指一种达到了人类智能的通用人工智能(AGI,Artificial General Intelligence),即拥有在各种环境下解决问题、学习、采取类似人类的有效行为能力的人工智能,而奇点的来临则意味着通用人工智能发展成不可知的超级人工智能(Artificial Super Intelligence),并且这一过程是不可逆的。 交待完这些背景,我们可以好好聊聊这本书了:《我们最后的发明----人工智能与人类时代的终结》!光从名字你也能看出作者是阴暗派。全书不少篇幅用耸人听闻的口吻描绘了超级人工智能将给人类带来的灭顶之灾,脑洞之大、之黑暗超过世上所有科幻作品,而且它们都来自于研究人工智能的业内人士。这部分人倾向认为超级人工智能,简单来说就是人类无法理解的一种强大智能,虽然它的初始算法是人类设计的,并且尽可能地在其中植入了“伦理框架”,但由于它是超级智能啊,它慢慢生出了天方夜谭般的进化速度,最终它与制造他的人类之间产生的差异尤如人与蚂蚁那么大!最终导致人类灭绝……这便是《我们最后的发明----人工智能与人类时代的终结》一书的作者----纪录片导演詹姆斯·巴拉特----一个追随人工智能领域二十载的技术爱好者最深的恐惧和忧虑所在。这本书整合了网络上260多篇业内有关人工智能的文章观点,以及与十多位业内人士的采访纪录;作者在全书十六个篇章重复不停地给公众大敲警钟:醒醒吧!别作人类即将进入辉煌时代的美梦了!我们已经大难临头了!逃都没地儿逃!因为超级人工智能终将占领全宇宙!(I’m just paraphrasing here 〜。〜) 这本书的封面是一个长相可爱眼神空洞的女机器人。我之所以硬着头皮读下去,全因为Musk推荐了这本书。他说有关AI风险的内容,这本《我们最后的发明》值得看看。于是我就找来看了。前几章给我的感受是导演作者拉上专家强行情绪化YY,好多地方欠严谨,论点和论据缺乏对应,看得我实在难受,全都用铅笔标了注。 书一共16章,除了最后几章,大部分章节都是以某位专业人士的冷静观点意见阐述交织以作者坚定不移的“人工智能若不施以监管全人类就会覆灭”的场景式描绘,他似乎认为大家都是火灾现场的沉睡者,焦急情态跃然纸面。书的前六章描绘了“忙碌小孩”即人工智能在科学家的推动下成为了AGI,全天24小时不眠不休----在“效率、自我保护、资源获取和创造力”四大动机的驱动下,通过自我正反馈循环,从通用人类智力极速跃升为超级智能,再到人类无法理解的“黑箱超级智能”的过程。詹姆斯·巴拉特着重强调,其从通用智能到黑箱超级智能的演化速度之快,根本容不得人类布局招架(用人机智能增强与之对抗或制衡)。借奇点研究所所长迈克尔·瓦萨(Michael Vassar)的脑海:超级智能从人类手中逃脱了。它殖民了太阳系,接着又殖民了我们的银河系。现在,它正用百万规范级巨型建设项目改造宇宙,它变成我们完全无法理解的Alien。未来,整个宇宙会变成一台计算机或头脑,这就是宇宙的命运。鲁莽地发展通用人工智能,注定了人类的灭绝,宇宙里其他的生物也不能幸免。一如超级人工智能并不爱我们也并不恨我们,对宇宙里的其他生物它也没有什么爱与恨。我们对通用人工智能的追求,很可能造成一场蔓延全星系的瘟疫。(Again, 这比我看过的任何科幻著作脑洞都要大!) 从普通人工智能成为超级人工智能的过程分析 看不进去以下艰(shi)深(fen)枯(you)燥(qu)内容的可以往下跳至“】”接着看: 【詹姆斯·巴拉特通过专业人员之口,介绍了有可能将目前的AI发展为AGI(通用人工智能),再发展为ASI(超级人工智能)的两种途径。不论哪一种路线,AI演化成AGI后带来的潜在危险是一样的,AGI将开始快速递归式自我改进,这让AI从通用人工智能摇身一变成为超级人工智能。通常,这个过程叫做“智能爆炸”。因为速度太快了! 途径一: 逆向大脑工程,即扫描大脑,生成以大脑为基础的回路集合。用算法或硬件网络再现这些回路,再在计算机里以统一的合成大脑形式启动,之后再教给它需要知道的一切。好几家组织都在着手此类项目。这条路线要求结合编程技巧和蛮力技术,对人类大脑进行逆向工程。所谓“蛮力”就是靠纯粹的硬件肌肉----成排的高速处理器,PB级(1PB即1000TB)的内存----再加上巧妙的编程来“压倒性”地解决问题。大脑逆向工程是计算机神经学的领域。这一领域的一位领军人物理查德·格兰杰认为,大脑的零部件充满冗余,它的连接不精确且缓慢,但它所用的工程原理,是人类能够借鉴的。这种方式开发出来的网络被称作脑源性神经网络。库兹韦尔等人相信这是实现AGI最短的路线,尽管最费钱。 IBM的SyNAPSE(System of Neuromorphic Adaptive Plastic Scalable Electronics,神经性自适应塑料可微缩电子系统)是目前人类大脑逆向工程最见成效的一个项目。这个项目始于2008年,从达帕(美国国防部高级研究计划局)得到了近3000万美元的拨款,利用IBM的系统复制哺乳动物大脑的基本技术:同时接收上千个输入源,不断发展核心算法,输出感知、思维和行动。它从猫大小的大脑开始,接着扩展到人类大脑的个头,再接着,突破这个限度。为构建它,SyNAPSE的研究人员创造了一台用数千个平行处理计算机芯片构成的“认知计算机”。利用纳米技术的发展,他们在1平方微米的面积上制作了芯片。现在,SyNAPSE对人类大脑的300亿神经元和100万亿连结点即突触做了镜像。它现已超过了大脑大约每秒1000万亿次的运算速度。制造人员为这套智能系统的核心部分编码了一套价值观和安全模块,植入了SyNAPSE数百万芯片里的每一个,确保系统友好。随着认知计算机变得愈发强大,它开始做一些影响世界的决定----比如如何处理恐怖主义,如何疏导逼近地球的小行星,如何延缓海平面升高,如何加速纳米药物的开始、治愈大多数的疾病。人们对这套友好AI寄以帮助人类度过智能爆炸的希望。但谁也不确定所谓的友好AI自身在度过智能爆炸时,是否会改更目标,继而改变“性格”。 途径二: 按照认知科学采用类似人类大脑运作方式的结构来建设AGI。这一派研究人员认为,对大脑进行逆向工程获得AGI太耗费时间了!举例来说,人类掌握飞行,不是靠对鸟类的翅膀进行逆向工程。人靠的是观察鸟类,进行实险,而后推导出飞行的原理,之后再出现相应的发明。认知科学就是大脑的“飞行原理”,包括了语言学、心理学、人类学、教育、哲学等等。运用这种方式架设AGI的一种代表是本杰明·戈策尔(Ben Goertzel)博士发展的认知结构“OpenCog”系统。戈策尔计划创造一个类似婴儿的AI“代理”,让它自由地在丰富多彩的虚拟世界里学习。他可以用知识数据库补充它的所知,或是赋予AI代理“自然语言处理”能力,让它阅读互联网。强大的学习算法(尚在建立中)以“概率性真值”(probabilistic truth values)来阐述知识,有了更多的例子或数据,AI代理可以改进对某事物的认识。概念性推理引擎(同样尚在开发中)则将赋予AI主体利用不完善证据进行推理的能力。依靠遗传编程,戈策尔可以训练AI演进出独特的新颖机器学习工具----也就是它自己的程序。这些程序能让代理展开实验和学习----针对环境提出正确的问题,拟定假说,加以检验。它学习的内容没有界限。如果它开发出更好的程序,就能改进自己的算法。 在这一途径下的突破案例,我查到康奈尔大学创意机器人实验室主任霍德·利普森(Hod Lipson)自我养成的机器人实验,包括让机器人自己学习走路,制造者先前并没有赋予它走路的程序;霍德·利普森还分享了在实验中他观察到的一个现象,即在让机器人学习区别狗脸和猫脸时,机器人却主动追踪人脸。也就是说,机器人不仅会学习你指定让他学习的东西,他还会主动去学习你没有交待他的东西,这就像小孩子的自我学习一样。这打破了机器人领域的禁区:即Consciousness(意识)。这里说的意识包括与外界的沟通以及与自己前一个活动的沟通。在利普森机器人学走路的实验中,机器人这两种沟通都有了。而且机器人还会对另一个机器人的思考进行思考。利普森实验中安排了一个执行追光的机器人,同时安排了一个监控执行追光机器人的机器人。这个监控机器人经过观察之后,居然会给执行追光的机器人设置陷阱,也就是说前者能够思考后者在想什么,然后根据这种思考行动。机器人一旦会学习,他的学习速度一定是惊人的,而且他是不知疲倦的,可以想像,他知识能力超越人类并不需要太长时间。利普森表示他并不担心AI本身,但他担心有人会利用AI。】 詹姆斯·巴拉特在新近一轮召开的AGI大会上,对参会的大约200名计算机科学家和人工智能爱好者做了一个非正式的调查:“你认为什么时候能够实现通用人工智能?”,并给了他们四个选项。最后,42%的人预期AGI在2030年实现,25%选择2050年,20%选择2100年,2%选择永远无法实现。可以看出,大部分与会人员接受了奇点主义代言人库兹韦尔提出的收益加速定律(Law of Accelerating Returns),相信信息技术呈指数发展,而不是线性发展。库兹韦尔的收益加速定律强调:有一套平滑的指数曲线支配着演进过程,技术的发展又和演进过程类似,技术发展出一种能力,进而又利用这一能力进化到下一阶段。就人类而言,体积庞大的大脑和对生拇指使得人能够制造工具,获得了能够高效使用工具的握力。就技术而言,印刷术促进了书藉装订、识字率,还有大学及更多发明创造的出现。蒸汽机推进了工业革命,催生了越来越多的发明。因为有依靠自身进行建构的习性,技术起初会很缓慢,但紧接着,它的增长曲线就变陡了,到最后近乎垂直攀升。 按照库兹韦尔绘制的图表,我们正进入技术演进的关键时期----指数曲线徒直的部分,也就是它的拐点。就从这儿开始,它将迅速上升。库兹韦尔用加速回报定律来描述以信息进化模式为代表的一切发展过程。他曾预见到了互联网的爆炸。库兹韦尔估计,大约2020年左右,我们就能拥有相当于人类大脑运算能力的笔记本电脑了。再换一种方式描述收益加速定律:所谓收益加速定律,就是技术的预测和进步像一列每英里速度都翻倍的列车向我们驶来----它到达速度快得难以觉察:如果这趟列车行驶完第一英里之后的时速是20英里,等过了15英里,它的时速就是65000英里。收益加速定律的效应远远超出计算机和智能手机行业,在全球变暖问题上,Google的创始人拉里·佩奇(Larry Page)和库兹韦尔都很乐观,他们认为20年内,纳米技术会让太阳能变得比石油、煤炭更经济。死亡问题同样触手可及,库兹韦尔认为既然我们现在已经掌握了理解生命软件及对其重新编程的切实手段,我们可以不受干扰地关掉基因,增添新的基因,用干细胞疗法培养出完整的全新器官。关键在于,医学现在是信息技术了,那么它的能力将每年翻一倍。20年里,按照相同的成本,这些技术会变得强大100多万倍。照库兹韦尔的说法,21世纪我们将在100个日历年里经历相当于20万年的技术进步。库兹韦尔认为这是人类通往天堂之路,可是,人类是否能够承受得来这么迅猛的进步?詹姆斯·巴拉特已经用本书标题回答了提出的问题:《我们最后的发明----人工智能与人类时代的终结》。 大多数人都会同意,技术是双刃剑。正如核能利用的好是生活能源,利用不当则成为原子弹这样的杀人武器。库兹韦尔认为,人工超级智能未经证实的好处大于未经证实的风险,如果因为一些技术太过危险就放弃开发他们,这不光是糟糕,还不道德。但巴拉特认为,如果不尽量多的向人说明潜在风险就开发AGI技术,才是不道德。他更担心的是超级人工智能会首先从达帕资助的军事领域诞生,或者由理性人理论和AI占据交易的金融领域首先诞生,无论从哪个领域诞生,这项黑科技在政府国防或财团赢利目的的影响下,只会更加不透明,更加深不可测。 “人的智力增强到比天还要高之后,他们的道德心变成什么样?” 除了对超级人工智能不可知的提醒外,他同样担心上层人士,如政治家或企业家会首先获得大幅增强大脑的机会。而军界以士兵原型制造的AGI若极速演化为ASI给这个世界带来的动荡就更加可想而知了。冷战虽然已经过去,但出于对国防、资源控制的需求,除美国外的国家也在加紧制造AGI,这样即使从国际局势制衡的角度来看,AGI的发展是不可能被喊停的,这就是巴拉特深为悲观的地方。 2009年,在加利福尼亚州,国际人工智能促进协会(Association for the Advancement of Artificial Intelligence, 简称AAAI)聚集了一批从业人士,探讨公众对机器人肆意横行、失去隐私、宗教式技术运动所感到的日益恐慌。会议组织者、微软研究员埃里克·霍维茨(Eric Horvitz)说: “过去5到8年,出现了一种新现象,技术专家提供宗教一般的愿景,他们的设想在某些方面跟神学里的‘被提’概念(新教末世论,无论是死是活,所有的基督徒将同时被送到天上与基督同在,并且凡体将升华为不朽的身体)很类似……我的感觉是,考虑到技术统治论者和非常关心智能机器崛起的人掀起了越来越大的声势,我们迟早要做出某种评估或陈述。” 埃里克·霍维茨概略的会议报告对智能爆炸、奇点和智能系统失控表示了怀疑。但协会敦促伦理学家和心理学家做进一步研究,同时,强调了日益复杂和高深的计算机系统潜在的危险,包括“自主或半自主决策系统做出的……代价过重、不可预见的行为。” 巴拉特认为,狂热地渴望永生的人,绝不愿意放缓、挑战有望实现其梦想的技术发展,或是用任何方式对之加以限制。他认为既然不能够控制他们的做法,作为技术门外汉们能做的就是,呼吁大众对此事的觉察,并在技术专家的帮助下,1.尽早开发友好AI,扭转局面----没有可能也要创造可能。2. 给强大的AI设立限制,比如设立法规它们必须默认包含死亡程序组件。 巴拉特在全书结尾又一次执着地强调自己的观察:整个社会几乎都忘了探索和监控这一危险。 “然而,一日复一日,机器从我们手里夺取着阵地;一天又一天,我们都对它们越来越依从;越来越多的人每天都变成了为伺候它们而努力,越来越多的人每天都把自己整个生命的能量用来发展机器的生命。结局无非是个时间的问题,但有必要问一问,机器什么时候将真正主宰世界,地球上的居民不再是有着真正哲学思想的人。” ----19世纪英国诗人、作家塞缪尔·巴特勒 (Samuel Butler) 后记: 这本书封面让我想到《新世纪福音战士》中的零号机驾驶员Rei (“think of”, not “remind”),年少时深深迷恋的人造人,一度有很强的代入感。这种迷恋直到读了《佛陀的启示》才止息。

人工智能占领全宇宙(Are You Kidding Me?!)

《我们最后的发明》热门书评

-

人工智能会成为人类的威胁吗?

2有用 0无用 纸艾特笔 2016-12-22

与其他介绍人工智能的书不同,《我们最后的发明》的作者詹姆斯•巴拉特是一个纪录片导演,并非计算机领域的专家学者。但也正因为他是一个纯粹记录的导演,他可以用局外人的眼光看待人工智能的发展,也能采访众多关注人工智能的专家,从而在书中给出更全面的信息。在书中提到过三种类型的人工智能,一种是弱AI或窄AI,即...

-

埃隆·马斯克推荐了这本书

1有用 0无用 拙尘 2016-08-16

...

...- 毁灭你,但与你无关

1有用 0无用 小翻译在劳作 2016-08-20

这篇译后记和全书略有唱反调。有可能并未出现在书里(不过我暂时还没收到样书,无法确认)。单纯从阅读的角度来说,我很推荐它,因为好玩、有趣、思路清奇、剑出偏锋,但从知识的角度来说,它其实不是那么“科学”、不那么“理性”。——————毁灭你,但与你无关说起来,我是怀着“机器翻译什么时候会取代人工翻译”这种...

- 与机器赛跑

1有用 0无用 子非鱼 2017-01-08

2013年的一本小手册《与机器赛跑》,其中主要讨论的是由于技术进步,导致大量就业岗位被机器人所取代,而技术进步的不断加速这一趋势将永久性地改变经济结构、就业机会和工人薪酬,意味着大量可被机器替代的就业岗位的消失,居高不下的失业率,以及贫富差距的不断扩大,将会成为未来的经济新常态。这一观点与当时主流的...

- 人工智能占领全宇宙(Are You Kidding Me?!)

0有用 0无用 M. 2017-04-11

近年来,奇点主义成为人工智能领域很火的思想潮流。奇点主义代言人雷·库兹韦尔(Ray Kurzweil)推出两本畅销书:《精神机器时代:当计算机超过人类智能》和《奇点临近》。他在书中预言:未来40年的某个时候,技术发展会迅猛异常,从根本上改变人类的生存,机器和生物会变得难分彼此;虚拟世界会比现实更加生...

书名: 我们最后的发明

作者: [美] James Barrat

出版社: 译言·东西文库/电子工业出版社

原作名: Our Final Invention

副标题: 人工智能与人类时代的终结

译者: 闾佳

出版年: 2016-8

页数: 344

定价: 68.00

装帧: 平装

丛书: 东西文库

ISBN: 9787121292538

- 毁灭你,但与你无关